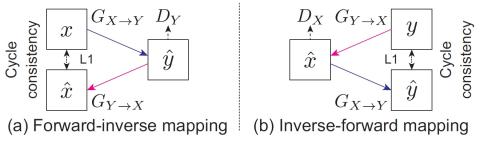

Мы предлагаем метод преобразования голоса без параллельных данных, который позволяет преобразовать исходную речь в целевую, не полагаясь на параллельные данные. Предлагаемый метод является универсальным, высококачественным, не требует параллельных данных и работает без каких-либо дополнительных данных, модулей или процедуры выравнивания. Это также позволяет избежать чрезмерного сглаживания, которое происходит во многих традиционных методах преобразования голоса, основанных на статистических моделях. Наш метод, называемый CycleGAN-VC, использует согласованную с циклом состязательную сеть (CycleGAN) со стробируемыми сверточными нейронными сетями (CNNS) и потерей идентификации при сопоставлении. CycleGAN изучает прямое и обратное сопоставления одновременно, используя потери при сопоставлении и циклической согласованности. Это позволяет найти оптимальную псевдопару из непарных данных. Кроме того, потери при сопоставлении способствуют уменьшению чрезмерного сглаживания преобразованной последовательности признаков. Мы настраиваем CycleGAN со встроенными CNN и обучаем его с потерей идентификации при сопоставлении. Это позволяет функции сопоставления фиксировать последовательные и иерархические структуры, сохраняя при этом лингвистическую информацию. Мы проверили наш метод на задаче параллельного преобразования голоса без передачи данных. Объективная оценка показала, что преобразованная последовательность признаков была близка к естественной с точки зрения глобальной дисперсии и спектров модуляции. Субъективная оценка показала, что качество преобразованного голоса было сопоставимо с качеством, полученным с помощью метода гауссовой смеси, основанного на модели, в благоприятных условиях при параллельном использовании и удвоенном объеме данных.

Обсуждение и выводы

Мы предложили метод преобразования голоса без параллельных данных под названием CycleGAN-VC, который использует CycleGAN с закрытыми каналами и потерей идентификации при сопоставлении. Этот метод позволяет изучить функцию сопоставления на основе последовательности без каких-либо дополнительных данных, модулей и процедуры выравнивания по времени. Объективная оценка показала, что последовательности MCEP, полученные с помощью нашего метода, близки к целевому показателю с точки зрения GV и MS. Субъективная оценка показала, что качество преобразованной речи было сопоставимо с качеством, полученным с помощью метода, основанного на GMM, в выгодных условиях при параллельном использовании и удвоенном объеме данных. Однако разница между исходным и преобразованным голосом все еще существует. Чтобы заполнить эту разницу, мы планируем применить наш метод к другим функциям, таким как STFT-спектрограммы, и к другим платформам синтеза речи, таким как преобразование голоса без вокодера. Кроме того, предлагаемый нами метод является общей основой, и возможная будущая работа включает в себя применение этого метода к другим приложениям для преобразования голоса.