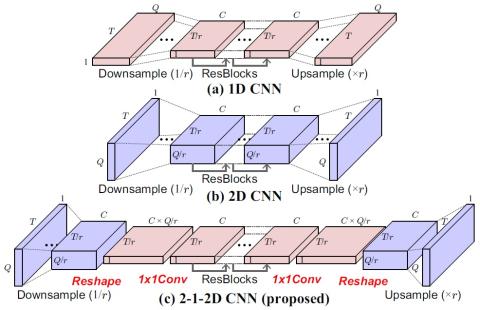

Непараллельное преобразование голоса - это метод преобразования исходной речи в целевую, не полагаясь на параллельные данные. Это важная задача, но она была сложной из-за недостатков условий обучения. Недавно CycleGAN-VC совершил прорыв и сравним с параллельным методом преобразования голоса, не прибегая к каким-либо дополнительным данным, модулям или процедурам выравнивания по времени. По-прежнему существует большой разрыв между реальным целевымй и преобразованным голосом, и преодоление этого разрыва остается сложной задачей. Чтобы сократить этот разрыв, мы предлагаем CycleGAN-VC2, который является улучшенной версией CycleGAN-VC, включающей в себя три новых метода: улучшенную цель (двухэтапный расчет потерь от соперничества), улучшенный генератор (2-1-2D CNN) и улучшенный дискриминатор (PatchGAN). Мы оценили наш метод на примере задачи непараллельного преобразования голоса и подробно проанализировали эффект от каждого метода. Объективная оценка показала, что эти методы помогают приблизить преобразованную последовательность признаков к цели как с точки зрения глобальной, так и с точки зрения локальной структуры, которую мы оцениваем с помощью расстояния до мелкосепстральных искажений и спектров модуляции соответственно. Субъективная оценка показала, что CycleGAN-VC2 превосходит CycleGAN-VC с точки зрения естественности и сходства для каждой пары говорящих, включая внутриполовые и межполовые пары.

Выводы

Чтобы продвинуть исследования в области непараллельного преобразования голоса, мы предложили CycleGAN-VC2, который представляет собой улучшенную версию CycleGAN-VC, включающую три новых метода: улучшенную цель (двухэтапный анализ потерь от соперничества), улучшенный генератор (2-1-2D CNN) и улучшенный дискриминатор (PatchGAN). Результаты экспериментов показывают, что Cyclegang-VC2 превосходит Cyclegang-VC как по объективным, так и по субъективным показателям для каждой пары дикторов. Предлагаемые нами методы не ограничиваются индивидуальным преобразованием голоса, и их адаптация к другим настройкам (например, многодоменному преобразованию голоса) и другим приложениям остается интересным направлением в будущем.