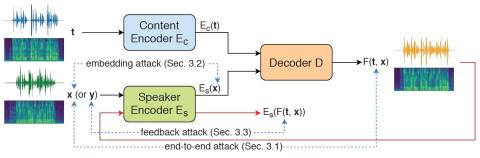

В последние годы были достигнуты существенные улучшения в преобразовании голоса, которое преобразует характеристики диктора в характеристики другого диктора без изменения лингвистического содержания высказывания. Тем не менее, усовершенствованные технологии преобразования также привели к проблемам конфиденциальности и аутентификации. Таким образом, становится очень желательным иметь возможность предотвратить неправильное использование своего голоса с помощью таких технологий преобразования голоса. Вот почему мы сообщаем в этой статье о первой известной попытке выполнить состязательную атаку на преобразование голоса. Мы вносим человеческий незаметный шум в высказывания диктора, чей голос должен быть защищен. Учитывая эти состязательные примеры, модели преобразования голоса не могут преобразовывать другие высказывания так, чтобы они звучали так, как будто их произносит защищаемый диктор. Предварительные эксперименты проводились на двух современных моделях преобразования голоса с нулевого раза. Представлены результаты объективной и субъективной оценки как в сценариях "белого ящика", так и в сценариях "черного ящика". Было показано, что речевые характеристики преобразованных высказываний были явно отличны от характеристик защищаемого диктора, в то время как состязательные примеры защищаемого диктора не отличимы от подлинных высказываний.

Выводы

Усовершенствованные методы преобразования голоса предполагают более высокий спрос на новые технологии для защиты личных характеристик диктора. Эта статья представляет собой первую известную попытку выполнить состязательную атаку на преобразование голоса. Предложены и испытаны три различных подхода на двух современных моделях преобразования голоса как в объективной, так и в субъективной оценке с очень обнадеживающими результатами, в том числе для сценария черного ящика, более близкого к реальным приложениям.